پردازش برداری و کلاسیک در 11.06 ترافلاپ در INT8 (FP8)، 5.53 ترافلاپس در FP16/BF16 و 2.76 ترافلوپس در FP32 تک دقیق کمی کندتر است. تراشه MTIA به طور خاص برای اجرای آموزش هوش مصنوعی و استنتاج در چارچوب هوش مصنوعی PyTorch Meta با یک Backend منبع باز Triton که کد کامپایل شده را برای عملکرد بهینه تولید می کند، طراحی شده است. متا از این برای همه مدلهای Llama خود استفاده میکند، و با Llama3 در گوشه و کنار، میتوان روی این تراشهها آموزش داد. متا برای مونتاژ آنها در یک سیستم، دو عدد از این تراشه ها را روی یک برد قرار می دهد و آنها را با 128 گیگابایت حافظه LPDDR5 جفت می کند. این برد از طریق PCIe Gen 5 به سیستمی متصل می شود که در آن 12 برد به صورت متراکم روی هم قرار گرفته اند. این فرآیند شش بار در یک قفسه برای 72 پنل و 144 تراشه در یک قفسه برای مجموع 101.95 پتافلاپ با فرض مقیاسبندی خطی با دقت INT8 (FP8) تکرار میشود. البته، مقیاسگذاری خطی در سیستمهای مقیاسپذیر کاملاً امکانپذیر نیست، که آن را به کمتر از 100 پتافلاپ در هر رک کاهش میدهد.

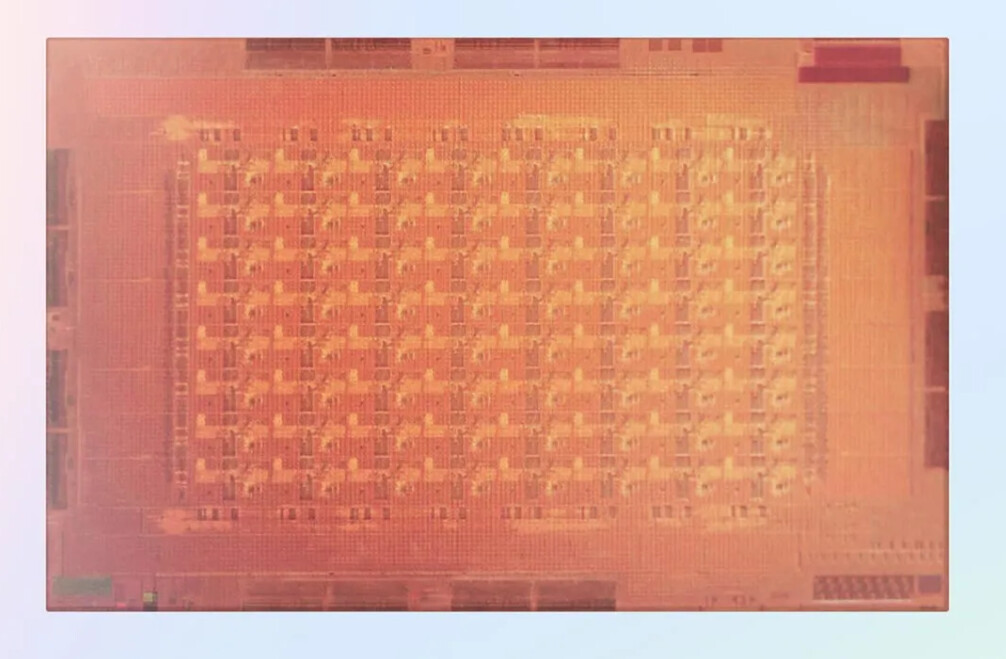

در زیر تصاویری از شماتیک و مشخصات چیپست نسبت به نسخه قبلی و همچنین سیستم را مشاهده می کنید.